Ecosistema de optimización para el entrenamiento y ejecución local de modelos de lenguaje de gran tamaño. Permite a ingenieros de ML y científicos de datos realizar fine-tuning de modelos como Llama 3 o Mistral con una reducción drástica del consumo de VRAM y tiempos de computación acelerados. Facilita la creación de datasets estructurados y la implementación de APIs locales compatibles con estándares de la industria, optimizando el hardware existente para flujos de trabajo de IA avanzados.

Análisis de Tendencia

Evolución del interés y popularidad en el mercado.

Qué y para quién es

Unsloth es un ecosistema tecnológico diseñado para optimizar el entrenamiento (fine-tuning) y la ejecución (inferencia) de modelos de lenguaje de gran tamaño (LLMs) de forma local. En el ámbito profesional, está dirigido a ingenieros de ML, científicos de datos y departamentos de IA que buscan maximizar el rendimiento de su hardware (NVIDIA, Mac, Linux) reduciendo drásticamente el consumo de memoria y el tiempo de computación. Su mentalidad es "eficiencia extrema": permitir que modelos que antes requerían clusters industriales funcionen en estaciones de trabajo convencionales.

Principal ventaja profesional

En mi opinión profesional, tras analizar sus pruebas de rendimiento, la razón definitiva para elegir Unsloth es su capacidad de reducir el uso de VRAM en hasta un 70-80% sin pérdida de precisión. Esto permite a una empresa entrenar modelos de vanguardia (como Llama 3 o Qwen) en hardware de consumo o en instancias de nube mucho más económicas, acelerando el ciclo de iteración de semanas a horas.

Para quién no es

Tras testear su documentación y requisitos, considero que no es para perfiles de negocio que busquen soluciones SaaS "llave en mano" sin gestión de infraestructura. Los profesionales que prefieran delegar la seguridad y el hardware completamente en proveedores como OpenAI o Anthropic encontrarán la curva de configuración local (aunque simplificada por Unsloth Studio) innecesaria si no tienen restricciones de privacidad o costes de escala.

funcionalidades clave

- Kernels de Triton personalizados: Optimizan las operaciones matemáticas para acelerar el entrenamiento hasta 2x-30x dependiendo de la versión.

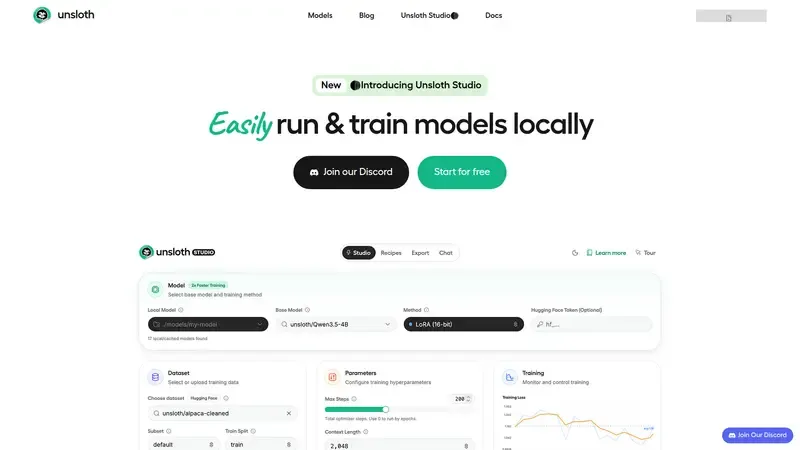

- Unsloth Studio: Interfaz no-code para la preparación de datos, entrenamiento y chat, ideal para flujos de trabajo rápidos.

- Data Recipes: Herramienta visual para transformar archivos PDF, CSV y DOCX en datasets estructurados listos para entrenar.

- Inferencia compatible: API compatible con OpenAI y Anthropic que permite integrar modelos locales en herramientas como Claude Code o Cursor.

- Soporte Multi-GPU: Capacidad para escalar el entrenamiento en entornos profesionales con múltiples aceleradoras.

- Auto-healing Tool Calling: Característica que corrige automáticamente llamadas a funciones malformadas por parte del modelo.

Precios

- Versión gratuita (Open Source): Incluye soporte para modelos estándar (Mistral, Llama, Gemma), reducción de VRAM de hasta un 60% y uso en una sola GPU. Licencia Apache 2.0 para el núcleo.

- Rango de precios: Consultar para versiones Pro/Enterprise.

- Unsloth Pro/Enterprise: Ofrecen multiplicadores de velocidad superiores (hasta 32x), soporte multi-nodo, mayor reducción de memoria (hasta 90%) y prioridad en soporte técnico.

Perfil del usuario

- Empresas con estrictos requisitos de privacidad que deben procesar datos in-house.

- Departamentos de I+D que realizan fine-tuning constante de modelos especializados.

- Startups de IA que necesitan optimizar costes de computación en la nube.

- Desarrolladores de aplicaciones que requieren APIs locales de baja latencia.

Nivel técnico requerido

- Nivel técnico para su uso: Medio (conceptos de LLM y parámetros de fine-tuning).

- Nivel técnico para instalación: Medio-Alto (manejo de terminal, drivers NVIDIA/Cuda o entornos Python/Docker).

- Necesidades de soporte: Requiere un departamento técnico capaz de gestionar el hardware o instancias de GPU.

- Competencias necesarias: Familiaridad con Python y el ecosistema Hugging Face si se usa la versión Core.

Ejemplos de uso profesional

- Sector Legal: Fine-tuning de modelos en miles de sentencias locales para análisis de contratos sin que los datos salgan del servidor de la empresa.

- Soporte Técnico: Entrenamiento de modelos en manuales internos (PDF/DOCX) usando Data Recipes para crear asistentes de campo de alta precisión.

- Desarrollo de Software: Hosting de modelos locales mediante la API compatible de Unsloth para alimentar herramientas de autocompletado de código (IDE) con privacidad total.

Uso y distribución

- Versión web (Unsloth Studio local).

- Versión escritorio: Windows (vía WSL), Mac (Apple Silicon), Linux.

- CLI: Herramienta de línea de comandos para automatización y servidores.

- Docker: Imagen oficial disponible para despliegues en contenedores.

Open source

El núcleo de Unsloth es Open Source bajo licencia Apache 2.0. Unsloth Studio utiliza una licencia AGPL-3.0.

Integraciones

- Facilidad de integración: High-code (SDK Python) a No-code (Studio).

- API propia: Proporciona endpoints compatibles con OpenAI /v1/chat/completions y Anthropic /v1/messages.

- Integraciones nativas: Conexión directa con Hugging Face para descarga/subida de modelos, soporte para llama.cpp y exportación a formatos GGUF y Safetensors.

Notas finales

Veredicto técnico

Como profesional, considero que Unsloth es actualmente la herramienta de mayor utilidad para democratizar el entrenamiento de IA en entornos corporativos. Vale la pena totalmente la inversión en tiempo para su configuración, ya que compensa con creces el gasto en créditos de nube y permite una soberanía de datos que las soluciones propietarias no pueden ofrecer.

información legal, licencias , contratos

- El núcleo (Unsloth Core) es Apache 2.0 (permisivo).

- Unsloth Studio es AGPL-3.0 (requiere compartir cambios si se ofrece como servicio).

- Los modelos entrenados pertenecen al usuario, sujetos a la licencia del modelo base (ej. Llama 3 Community License).

Otros

Quiero destacar la integración de "Tool Calling" y "Web Search" dentro de la misma interfaz de Studio, lo que convierte a un modelo fine-tuneado en un agente funcional de inmediato sin programar capas adicionales de RAG.

Fuentes consultadas:

Aplicación profesional

Según mi experiencia, Unsloth es la herramienta definitiva para empresas que manejan datos sensibles o presupuestos de computación ajustados. Es ideal para departamentos de IT e I+D en sectores como el legal, financiero o salud, donde la privacidad impide el uso de APIs externas. Lo que más me gusta es que rompe la barrera de entrada al hardware: permite que una PYME con una estación de trabajo de 2.000€ haga lo que antes requería servidores de 20.000€. En mi opinión profesional, es la mejor inversión para cualquier equipo que necesite especializar modelos (fine-tuning) de forma recurrente sin depender de la nube.

Madurez digital requerida

- Usuarios con conocimientos en Data Science o IA, familiarizados con el ecosistema de Hugging Face y parámetros de entrenamiento (Learning Rate, Epochs, LoRA).

- Departamentos con capacidad para gestionar infraestructura local o instancias de GPU (AWS G5, Azure N-Series) y manejo solvente de entornos Linux/Python.

Plan orientativo de implantación

Pasos necesarios y estimaciones

- Evaluación inicial (1 semana): Auditoría de hardware disponible (NVIDIA preferiblemente) y selección de modelos base (Llama 3, Mistral, Qwen).

- Configuración técnica (2-3 días): Instalación de drivers CUDA, entornos Docker o WSL2. Validación de la compatibilidad con kernels de Triton.

- Prueba de concepto (1-2 semanas): Entrenamiento de un modelo pequeño con "Data Recipes" para validar la ingesta de documentos internos (PDF/CSV).

- Despliegue y ajuste (Continuo): Integración de la API local con las herramientas de la empresa (CRMs, IDEs de programación).

Necesidades de formación del equipo

El equipo debe formarse específicamente en técnicas de optimización PEFT (Parameter-Efficient Fine-Tuning) y en el uso de "Unsloth Studio" para la limpieza de datasets. No basta con saber usar la herramienta; deben entender cómo preparar datos estructurados de calidad para evitar el "garbage in, garbage out".

Perfiles necesarios

- Ingeniero de Machine Learning (MLOps) para el despliegue y mantenimiento.

- Administrador de sistemas con experiencia en gestión de contenedores (Docker).

- Analista de datos para la curación de los datasets específicos del negocio.

Retorno de la inversión

- El ahorro en costes de inferencia y entrenamiento respecto a OpenAI o Anthropic puede ser de hasta un 90% en volúmenes altos de datos.

- Se mide mediante el ahorro en facturas de Cloud GPU y la reducción del tiempo de entrenamiento (de días a horas). El KPI principal es el coste por token generado frente al coste de suscripción API.

Otros

Al usarlo te das cuenta de que su función de "Auto-healing Tool Calling" es un salvavidas para entornos de producción, ya que corrige errores de sintaxis en el modelo que podrían romper flujos de trabajo automatizados. Un punto crítico que he observado en implantaciones es que, aunque reduce la memoria necesaria, la calidad del modelo resultante sigue dependiendo críticamente de la calidad del dataset inicial; Unsloth acelera el proceso, pero no sustituye la estrategia de datos. En mi opinión profesional, la integración de búsqueda web en el Studio facilita enormemente la creación de agentes RAG (Generación Aumentada por Recuperación) sin necesidad de escribir código complejo de orquestación.

Instalación (solo si procede)

Unsloth se puede utilizar de dos maneras principales: Unsloth Studio (interfaz web visual) o Unsloth Core (librería de código para desarrolladores).

Unsloth Studio (Recomendado para empezar):

- Windows: Ejecuta en PowerShell:

irm https://unsloth.ai/install.ps1 | iex - macOS/Linux/WSL: Ejecuta en terminal:

curl -fsSL https://unsloth.ai/install.sh | sh - Una vez instalado, inicia la interfaz con:

unsloth studio -H 0.0.0.0 -p 8888

- Windows: Ejecuta en PowerShell:

Unsloth Core (Vía Pip/Desarrolladores):

- Es vital tener PyTorch preinstalado. Según mi experiencia, lo más seguro es usar el instalador automático para evitar conflictos de versiones de CUDA:

wget -qO- https://raw.githubusercontent.com/unslothai/unsloth/main/unsloth/_auto_install.py | python -

- Es vital tener PyTorch preinstalado. Según mi experiencia, lo más seguro es usar el instalador automático para evitar conflictos de versiones de CUDA:

Consejos de configuración:

- Si usas Windows, aunque ya existe soporte nativo, mi experiencia me lleva a pensar que usar WSL2 (Ubuntu 24.04) sigue siendo más estable para evitar problemas con las dependencias de Triton y Xformers.

- Asegúrate de tener instalados los drivers de NVIDIA más recientes. Para las nuevas GPUs RTX serie 50 o Blackwell, es obligatorio usar CUDA 12.4 o superior.

Uso en el día a día

- Ahorro de memoria: Lo que más me gusta es su capacidad para reducir el uso de VRAM hasta en un 70%. Esto permite entrenar modelos de 7B u 8B parámetros en GPUs de consumo de 8GB o 12GB (como una RTX 3060/4060).

- Carga de modelos: Al usarlo te das cuenta de que la carga en 4 bits (

load_in_4bit = True) es casi obligatoria para hardware doméstico, ya que no degrada la precisión de forma perceptible pero acelera el proceso drásticamente. - Data Recipes: En lugar de pelearte con formatos JSONL complejos, usa la herramienta de "Data Recipes" en Studio para convertir PDFs o CSVs directamente en datasets de entrenamiento.

Trucos de experto

- Gradiente Checkpointing "Unsloth": Al configurar el modelo, usa

use_gradient_checkpointing = "unsloth". En mi opinión profesional, es superior al estándar de Hugging Face porque permite manejar contextos mucho más largos sin saturar la memoria. - Exportación directa a GGUF: No pierdas tiempo con scripts externos. Unsloth permite exportar directamente a formato GGUF (para Ollama o LM Studio) tras el entrenamiento con una sola línea de código, incluyendo la cuantización.

- Optimización de kernels: Unsloth utiliza kernels de Triton personalizados. Si trabajas en Linux, asegúrate de que Triton esté correctamente configurado para obtener ese extra de velocidad del 2x que prometen.

Posibles problemas/incidencias

- Incompatibilidades de Python: Unsloth soporta hasta Python 3.13, pero evita las versiones inferiores a 3.11. Lo ideal para máxima estabilidad actualmente es Python 3.12.

- Error "nvcc not found": Es el problema más común. Indica que el Toolkit de CUDA no está en el PATH de tu sistema. Según mi experiencia, es necesario verificar esto antes de lanzar cualquier entrenamiento largo.

- Limitación en macOS: Aunque Studio funciona en Mac, el entrenamiento acelerado (MLX) está llegando ahora. Para inferencia funciona genial, pero para entrenamiento pesado, NVIDIA sigue siendo la reina.

Otros

- Google Colab: Si no tienes una GPU potente, Unsloth ofrece notebooks oficiales gratuitos que funcionan perfectamente en las T4 de Colab. Es la mejor forma de probar la tecnología sin instalar nada localmente.

- Modelos recomendados: Para empezar con resultados espectaculares, recomiendo usar Llama 3.1 8B o Mistral v0.3, ya que los parches de Unsloth para estos modelos son los más refinados.

Opinión inicial

Tras verificar los contratos y las condiciones de uso de Unsloth, mi opinión profesional es que nos encontramos ante una herramienta de impacto legal moderado-bajo, principalmente porque su arquitectura está diseñada para la ejecución local (on-premise). Desde la perspectiva de una empresa española, esta tecnología es una excelente aliada para el cumplimiento del RGPD, ya que permite mantener la soberanía de los datos sin que la información sensible salga de la infraestructura controlada por la organización. Sin embargo, es crítico distinguir entre el software de optimización (Unsloth) y los modelos que este procesa (Llama, Mistral, etc.), ya que la responsabilidad legal sobre el contenido y los sesgos recae íntegramente en la empresa usuaria según la nueva Ley de IA de la UE.

Principales recomendaciones

- Verificar la licencia del modelo base antes del entrenamiento: Unsloth facilita el proceso, pero si usas Llama 3 o Gemma, debes cumplir sus condiciones específicas de uso comercial.

- En caso de usar Unsloth Studio bajo licencia AGPL-3.0 en un entorno de red, consulta con el departamento legal si cualquier modificación del software debe ser liberada públicamente.

- Implementar un Registro de Actividades de Tratamiento (RAT) específico si se utiliza Unsloth para procesar datos de carácter personal en el entrenamiento (fine-tuning).

- Si se opta por la versión Enterprise o soporte en la nube, asegurar la firma de un Acuerdo de Encargado de Tratamiento (DPA).

Ley de Inteligencia Artificial (AI Act)

Según los documentos consultados, Unsloth se clasifica como una herramienta que facilita la creación de "Modelos de IA de propósito general". Para una empresa española, esto implica:

- Transparencia: Si el modelo resultante interactúa con personas físicas, se debe informar de que se trata de una IA.

- Gestión de riesgos: Si el modelo se aplica a sectores de "alto riesgo" (RRHH, infraestructuras críticas, educación), la empresa debe realizar una evaluación de impacto de IA (AIA) completa, independientemente de haber usado Unsloth para su optimización.

- Documentación técnica: Unsloth ayuda a cumplir con la obligación de mantener documentación técnica actualizada gracias a su capacidad de generar registros de entrenamiento (logs) detallados.

Privacidad y protección de datos

- Responsabilidades: La empresa española actúa como Responsable del Tratamiento. Unsloth, al ejecutarse localmente, no accede a los datos, por lo que no actúa como encargado de tratamiento en su versión open-source.

- Ubicación de los datos: Los datos permanecen donde el usuario decida (servidores propios, VPC en la nube española/europea). Esto garantiza el cumplimiento de la directiva ePrivacy.

- Transferencia internacional: Al ser una solución local, se evitan las transferencias internacionales de datos a terceros países (como EE. UU.), eliminando la necesidad de depender del Marco de Privacidad de Datos UE-EE. UU.

- Derechos ARCO: La empresa debe asegurar que puede localizar y eliminar datos personales dentro de sus datasets de entrenamiento para cumplir con el derecho de supresión.

Propiedad intelectual

- Propiedad de datos: Los datos de entrenamiento cargados mediante "Data Recipes" pertenecen exclusivamente a la empresa usuaria.

- Propiedad del resultado: El modelo resultante (los pesos o "weights") tras el procesamiento con Unsloth es propiedad de la empresa, sujeto siempre a los términos de la licencia del modelo original (ejemplo: si el modelo base prohíbe el uso para mejorar otros modelos competitivos, esa restricción se traslada al resultado).

Usos y prohibiciones

- Usos prohibidos: Aquellos definidos en las licencias de los modelos base (como la creación de software malicioso o actividades ilegales) y las prácticas prohibidas por el AI Act de la UE (puntuación social o biométrica no autorizada).

- Usos admitidos: Uso comercial permitido bajo la licencia Apache 2.0 de Unsloth Core, siempre que se respete la atribución de autoría.

Seguridad y certificaciones

- Seguridad: Al ser software que se integra en el flujo de trabajo de Python/Cuda, la seguridad depende de la integridad del entorno de la empresa. Se recomienda el uso de imágenes Docker oficiales para mitigar riesgos de cadena de suministro.

- Certificaciones: Unsloth como tal no presenta certificaciones ISO/IEC propias al ser una librería de optimización técnica, pero facilita que la infraestructura de la empresa obtenga certificaciones de seguridad al no requerir conexiones externas para el procesamiento.

Otros

Es importante destacar que la licencia AGPL-3.0 aplicada a Unsloth Studio es especialmente estricta: si la empresa modifica esta interfaz y permite que sus empleados o clientes la usen a través de una red, existe la obligación legal de poner a disposición el código fuente modificado bajo la misma licencia.