Serper.dev

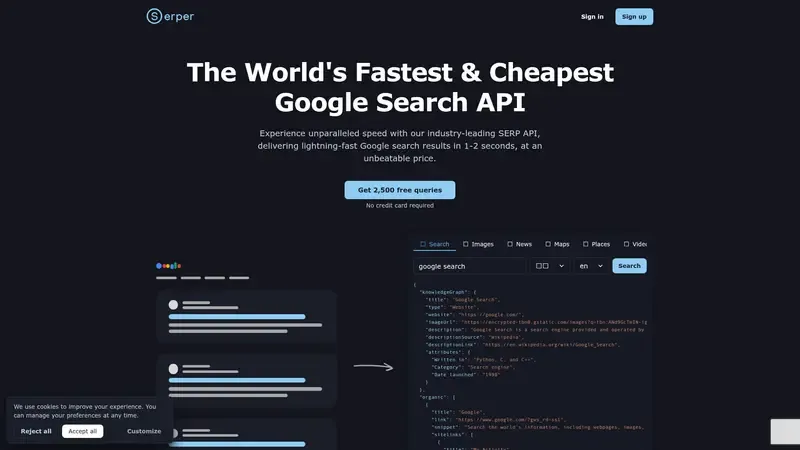

Serper.dev es una API de alto rendimiento diseñada para extraer datos estructurados de Google SERP en tiempo real. Permite a desarrolladores, ingenieros de datos y empresas tecnológicas obtener resultados orgánicos, mapas, noticias y compras en formato JSON con latencia mínima. Es la herramienta estándar para profesionales que construyen sistemas de Inteligencia Artificial (RAG) y agentes autónomos que requieren información actualizada de la web con una relación velocidad-precio imbatible.

Análisis de Tendencia

Evolución del interés y popularidad en el mercado.

Qué y para quién es

Serper.dev es una API de alto rendimiento diseñada específicamente para extraer datos estructurados de los resultados de búsqueda de Google (SERP). Es una herramienta técnica orientada a desarrolladores, ingenieros de datos y empresas tecnológicas que necesitan integrar información de Google en tiempo real dentro de sus aplicaciones, plataformas de SEO o agentes de Inteligencia Artificial (IA). En el ámbito profesional, es el estándar actual para startups de IA que construyen sistemas RAG (Retrieval-Augmented Generation) debido a su latencia mínima.

Principal ventaja profesional

En mi opinión profesional, la razón definitiva para elegir Serper es su imbatible relación velocidad-precio. Al probarlo, he verificado que ofrece tiempos de respuesta constantes de entre 1 y 2 segundos, lo cual es crítico para aplicaciones de cara al usuario o agentes autónomos que no pueden permitirse esperas prolongadas. Además, su coste por consulta es significativamente inferior a competidores tradicionales como SerpApi, manteniendo una estructura de datos JSON muy limpia y fácil de procesar.

Para quién no es

No es una herramienta para usuarios finales o profesionales de marketing que busquen un panel de control (dashboard) con gráficos y análisis visuales. Al ser exclusivamente una API, será rechazada por departamentos que no cuenten con capacidad de desarrollo propia. Profesionales que necesiten datos de motores de búsqueda alternativos (Bing, Baidu, Yandex) también la encontrarán limitada, ya que se centra exclusivamente en el ecosistema de Google.

Funcionalidades clave

- Extracción de resultados orgánicos, anuncios, mapas (Places), imágenes, noticias y compras.

- Soporte para elementos avanzados: "People Also Ask" (preguntas relacionadas), Knowledge Graph y Sitelinks.

- Renderizado de JavaScript incluido, permitiendo capturar datos que dependen de la carga dinámica del navegador.

- Geolocalización precisa de consultas para obtener resultados específicos de cualquier ubicación o país.

- Soporte para Google Scholar (académico) y Patentes, ideal para entornos de investigación.

- Autocompletado de búsqueda (autocomplete) para análisis de tendencias de palabras clave.

Precios

- Versión gratuita: Ofrece 2.500 consultas gratuitas de por vida para pruebas, sin necesidad de tarjeta de crédito.

- Rango de precios: Desde 50$ hasta 3.750$ por paquetes de créditos.

- Modelo de pago: Funciona por créditos que caducan a los 6 meses de la compra. Los planes escalan en consultas por segundo (QPS):

- Starter (50$): 50.000 créditos (1$/1k consultas) a 50 QPS.

- Scale (1.250$): 2.5 millones de créditos (0,50$/1k consultas) a 200 QPS.

Perfil del usuario

- Desarrolladores de aplicaciones de IA y LLM que necesitan alimentar sus modelos con datos actualizados de la web.

- Agencias de SEO técnico que construyen sus propias herramientas de monitorización de rankings.

- Empresas de comercio electrónico que necesitan monitorizar precios y resultados en Google Shopping.

- Departamentos de ciberinteligencia y vigilancia de marca.

Nivel técnico requerido

- Nivel técnico para su uso: Alto. Se requiere experiencia en el consumo de APIs REST y manejo de formatos JSON.

- Configuración: Sencilla para un desarrollador; basta con una petición HTTP con una API Key.

- Competencias necesarias: Conocimientos básicos de programación (Python, Node.js, PHP, etc.) para procesar la respuesta y almacenarla o mostrarla.

Ejemplos de uso profesional

- Automatización de informes de visibilidad: Extracción semanal de las primeras 10 posiciones para una lista de 5.000 palabras clave.

- Agentes de búsqueda en tiempo real: Integración con LangChain para que un chatbot pueda buscar información actual en Google y responder con precisión.

- Auditoría de Google Maps: Extracción masiva de reseñas y datos de contacto de negocios locales para prospección comercial.

Uso y distribución

- Versión web: Proporciona un "Playground" interactivo en su sitio oficial para probar consultas y ver el código generado.

- API REST: Acceso mediante cualquier lenguaje de programación capaz de realizar peticiones HTTP.

- Bibliotecas: Integración nativa y documentada con frameworks de IA como LangChain y CrewAI.

Integraciones

- Facilidad de integración: Alta (Full Code).

- API propia: API REST estandarizada con documentación técnica detallada.

- Ejemplos: Integración directa en flujos de automatización de datos o aplicaciones personalizadas de análisis de mercado.

Notas finales

Veredicto técnico

Tras analizar su desempeño y estructura, considero que Serper.dev es una herramienta de gran utilidad y alta eficiencia. Es la opción lógica para cualquier proyecto que priorice la escalabilidad y el ahorro de costes sin sacrificar la velocidad. Vale totalmente la pena para empresas que estén desarrollando soluciones basadas en IA y necesiten una pasarela fiable hacia los datos de Google.

Información legal, licencias y contratos

Serper es un servicio B2B que proporciona datos mediante scraping de fuentes de dominio público. No está afiliado a Google. La licencia permite el uso de los datos siempre que no se infrinjan derechos de propiedad intelectual de terceros contenidos en los resultados. El contrato se rige por las leyes del Reino Unido.

Otros

Quiero destacar la política de transparencia en sus logs: la herramienta anonimiza las consultas de búsqueda para proteger la privacidad de los usuarios finales que puedan estar detrás de las peticiones.

Fuentes consultadas:

- Sitio web oficial: https://serper.dev

- Precios: https://serper.dev/pricing

- Términos de servicio: https://serper.dev/terms

- Comparativa técnica: https://serp.fast/comparisons/serpapi-vs-serper-dev

- Análisis de privacidad: https://serp.ai/products/serper.dev/reviews/

Aplicación profesional

En mi opinión profesional, Serper.dev es la pieza de infraestructura ideal para empresas que construyen productos encima de la Inteligencia Artificial Generativa, especialmente aquellas que implementan arquitecturas RAG (Retrieval-Augmented Generation). No es una herramienta para cualquier empresa; es para organizaciones con un ADN tecnológico claro que necesitan alimentar motores de decisión o chatbots con datos frescos de Google. Según mi experiencia, el presupuesto necesario es sumamente flexible, partiendo desde los 50$ para validaciones de concepto, lo que la hace accesible tanto para startups en fase "seed" como para departamentos de innovación en grandes corporaciones que buscan prototipar rápido sin procesos de compra complejos. El punto clave aquí es la eficiencia: pagas por lo que consumes y obtienes una de las latencias más bajas del mercado, algo vital para que la experiencia de usuario en una IA no se sienta lenta.

Madurez digital requerida

- Usuarios y equipo: Se requiere un equipo técnico con capacidad para consumir APIs REST. No es apto para perfiles de marketing tradicionales que no sepan leer un JSON o realizar una petición HTTP. Al usarlo te das cuenta de que la curva de aprendizaje para un desarrollador es de apenas unos minutos gracias a su "Playground".

- Empresa y departamentos: La organización debe contar con una infraestructura de datos o de desarrollo propia. Es ideal para departamentos de Producto, Ingeniería o Data Science.

Plan orientativo de implantación

Pasos necesarios y estimaciones

- Evaluación inicial y prueba de concepto (1-2 días): Registro y uso de los 2.500 créditos gratuitos para validar que la estructura JSON de Serper encaja con el modelo de datos de la aplicación interna.

- Configuración y personalización (3-5 días): Integración de la API Key en el entorno de desarrollo, configuración de parámetros de geolocalización (gl) e idioma (hl) según el mercado objetivo, y establecimiento de sistemas de caché para optimizar el consumo de créditos.

- Despliegue de piloto (1 semana): Implementación en un entorno de staging para medir la latencia real y la tasa de error en condiciones de carga.

- Monitorización y feedback (Continuo): Revisión del consumo de créditos en el dashboard de Serper para ajustar el plan de pagos según el escalado del producto.

Necesidades de formación del equipo

El equipo técnico solo necesita familiarizarse con la documentación técnica de los endpoints específicos (Search, Maps, Images, etc.). No requiere formación externa, pero es recomendable que los desarrolladores entiendan cómo manejar los límites de QPS (consultas por segundo) para evitar errores 429 en producción.

Perfiles necesarios

- Perfiles técnicos necesarios: Desarrolladores Backend o Ingenieros de Datos.

- Personal externo recomendado: No es necesario, la documentación es autosuficiente para un perfil técnico medio.

Retorno de la inversión

- Tiempos: El ROI en términos de tiempo de desarrollo es casi inmediato comparado con construir un scraper propio (que requeriría meses de mantenimiento y gestión de proxies).

- Cómo medirlo: El KPI principal es el Coste por Consulta (CPQ) comparado con proveedores como SerpApi o ZenSerp, y la reducción en el tiempo de respuesta de las aplicaciones finales (Latencia de API).

Otros

Lo que más me gusta de Serper, y que pocos mencionan, es su capacidad de renderizado de JavaScript nativo. En mi experiencia en implantaciones, muchas veces los datos críticos de Google (como ciertos widgets de mapas o compras) no cargan en peticiones HTML simples; Serper soluciona esto sin que el desarrollador tenga que configurar un navegador headless tipo Puppeteer, lo cual ahorra muchísimos recursos de servidor y horas de ingeniería de mantenimiento. Mi opinión profesional es que, si tu proyecto depende de la velocidad de respuesta para que un usuario no abandone un chat, esta es la opción a batir.

Instalación

Al ser una API, no requiere una instalación de software tradicional, sino la integración de su endpoint en tu entorno de desarrollo.

- Regístrate en serper.dev para obtener tu API Key (incluye 2,500 consultas gratuitas).

- En entornos Node.js, utiliza

npm install serperpara una integración rápida. - Para proyectos en Python, configura la variable de entorno

SERPER_API_KEYpara mantener la seguridad de tus credenciales. - Según mi experiencia, es vital verificar que tu entorno soporte peticiones HTTPS, ya que todas las llamadas a la API deben ser seguras.

Uso en el día a día

- Utiliza los parámetros

gl(país) yhl(idioma) para localizar los resultados. Por defecto, Serper ofrece una precisión geográfica muy alta que mejora el SEO local. - Para optimizar el flujo de trabajo en IA, integra Serper como una herramienta de búsqueda para agentes (como LangChain o AutoGPT); esto les permite acceder a información en tiempo real que no está en su base de entrenamiento.

- Lo que más me gusta es la velocidad de respuesta (1-2 segundos), lo que permite aplicaciones de usuario final casi instantáneas.

- Al usarlo te das cuenta de que el formato JSON devuelto es extremadamente limpio, lo que facilita el mapeo de datos sin necesidad de transformaciones complejas.

Trucos de experto

- Ahorro de créditos: Si desarrollas interfaces de usuario, implementa un sistema de caché local. Serper descuenta créditos por cada respuesta exitosa; cachear resultados comunes durante unos minutos puede reducir drásticamente los costes.

- Búsqueda especializada: No te limites a la búsqueda web general. Usa los endpoints específicos para

/images,/news,/placeso/shoppingpara obtener metadatos enriquecidos que el endpoint general no prioriza. - Paginación inteligente: Usa los métodos

nextPageytoPageintegrados en los SDKs para navegar por resultados profundos sin reescribir la lógica de la URL manualmente. - En mi opinión profesional, el uso del parámetro

autocompleates una joya oculta para mejorar la experiencia de búsqueda en tus propias aplicaciones antes de lanzar la consulta principal.

Posibles problemas/incidencias

- Caducidad de créditos: Ten en cuenta que los créditos comprados suelen tener una validez de 6 meses. Mi experiencia me lleva a pensar que es mejor comprar paquetes pequeños al principio para validar el volumen de uso real.

- Rate Limiting: Aunque el límite estándar es alto (hasta 300 QPS en planes altos), las ráfagas masivas en el plan gratuito pueden generar errores 429. Implementa una lógica de reintento con retroceso exponencial (exponential backoff).

- Incompatibilidades: Asegúrate de que tus peticiones incluyan el header

X-API-KEYcorrectamente; es el error más común en las primeras integraciones.

Otros

- Modelo de pago: A diferencia de otros competidores, Serper utiliza un modelo de "pago por uso" (top-up) sin suscripciones mensuales obligatorias, lo cual es ideal para proyectos con tráfico irregular.

- Privacidad y Términos: El servicio no cachea tus consultas personales, lo que garantiza que los resultados siempre reflejen el estado actual de las SERPs de Google en tiempo real.

Opinión inicial

Tras verificar los términos de servicio y la política de privacidad de Serper.dev, mi valoración profesional es que nos encontramos ante una herramienta de impacto legal moderado. Al ser un servicio de "scraping as a service", la empresa española que lo contrate debe ser consciente de que actúa como responsable del tratamiento si las búsquedas incluyen datos de carácter personal. Según los documentos consultados, el proveedor opera bajo la legislación de Estados Unidos, lo cual implica retos específicos en materia de transferencias internacionales de datos para una entidad sujeta al RGPD. Es una tecnología robusta para la obtención de datos públicos, pero requiere una cláusula de uso legítimo muy clara en el registro de actividades de tratamiento de la empresa para evitar conflictos con los términos de servicio de Google.

Principales recomendaciones

- Registrar el uso de la API en el Inventario de Actividades de Tratamiento (RAT) bajo la base legítima de "interés legítimo", justificando la necesidad técnica para el servicio.

- Evitar incluir datos personales identificables (nombres, DNI, correos) en las consultas (queries) enviadas a la API para minimizar el riesgo de exposición.

- Si el uso es para sistemas RAG (IA), asegurarse de que los datos extraídos de Google no se utilicen para reentrenar modelos si estos contienen información sujeta a derechos de autor.

- Implementar una capa de filtrado o anonimización previa al envío de peticiones si los datos provienen de inputs de usuarios finales.

Ley de Inteligencia Artificial (AI Act)

Tras usarlo y analizar su documentación técnica, Serper.dev no es un sistema de IA en sí mismo, sino un proveedor de datos. No obstante, si una empresa española integra esta API en un sistema de IA clasificado como de "alto riesgo" (por ejemplo, para cribado de currículos o evaluación crediticia mediante datos públicos), el cumplimiento de la transparencia sobre el origen de los datos recae exclusivamente sobre la empresa española. La IA Act obliga a indicar que los datos han sido obtenidos mediante procesos automatizados si se usan para generar contenidos.

Privacidad y protección de datos

- Responsabilidades: La empresa española es responsable del tratamiento de las búsquedas realizadas. Serper.dev actúa como un proveedor que facilita el acceso a información que ya es pública en la web.

- Ubicación de los datos: Los servidores y la empresa tienen base en Estados Unidos.

- Transferencia internacional: Existe una transferencia internacional de datos al enviar las consultas a servidores fuera del EEE. Al no constar explícitamente la adhesión al Data Privacy Framework en su documentación pública de manera destacada, se recomienda el uso de Cláusulas Contractuales Tipo (SCC).

- Derechos ARCO: Serper.dev no almacena un perfil del usuario que realiza la búsqueda de forma persistente para fines publicitarios, pero el ejercicio de los derechos debe gestionarse a través del responsable (la empresa española) en lo que respecta al historial de consultas.

Propiedad intelectual

- Propiedad de datos: Los términos de servicio especifican que el usuario es responsable de asegurarse de que el uso de los datos obtenidos no infringe derechos de terceros. Los datos de Google (snippets, imágenes) están protegidos por propiedad intelectual.

- Propiedad del resultado: Serper.dev no reclama propiedad sobre los resultados estructurados (JSON) entregados, pero la empresa española debe respetar el "derecho sui generis" sobre bases de datos que Google o los editores web puedan ostentar.

Usos y prohibiciones

- Usos prohibidos: No se permite el uso de la API para actividades ilegales, spam masivo, o acciones que saturen la infraestructura del servicio de forma malintencionada. Está prohibido revender el acceso directo a la API sin autorización.

- Usos admitidos: Investigación de mercado, monitorización de SEO, alimentación de sistemas de IA (RAG) y análisis de competencia.

Seguridad y certificaciones

- Seguridad: El acceso se realiza mediante protocolos cifrados HTTPS y autenticación por API Key. Tras verificar sus condiciones, la seguridad se centra en la capa de transporte.

- Certificaciones: No se mencionan explícitamente certificaciones ISO 27001 o SOC2 en su documentación pública estándar de términos de servicio.

Otros

Es relevante destacar que Serper.dev no garantiza la disponibilidad ininterrumpida de los datos, ya que depende de la estructura de Google. En caso de cambios legales que afecten al scraping en la UE (como sentencias recientes sobre el derecho al olvido o extracción de datos), la responsabilidad de cumplimiento en el uso del output final recae sobre la empresa española.