PicoClaw es un asistente de IA personal y agente autónomo de ultra-bajo consumo diseñado para ingenieros de sistemas, desarrolladores de IoT y responsables de IT. Permite desplegar agentes inteligentes en hardware de coste mínimo (desde 10$) y recursos limitados (menos de 10MB de RAM). Es ideal para ejecutar lógica de IA en dispositivos periféricos (Edge Computing), servidores antiguos o infraestructuras locales sin depender de máquinas potentes ni incurrir en altos costes de mantenimiento.

Análisis de Tendencia

Evolución del interés y popularidad en el mercado.

Qué y para quién es

PicoClaw es un asistente de IA personal y agente autónomo de ultra-bajo consumo desarrollado por Sipeed. Está diseñado específicamente para ejecutarse en hardware de coste mínimo (desde 10$) y con recursos extremadamente limitados (menos de 10MB de RAM).

En el ámbito profesional, está orientado a ingenieros de sistemas, desarrolladores de IoT y responsables de IT que buscan desplegar agentes de IA en infraestructuras locales, dispositivos periféricos (Edge Computing) o servidores antiguos, sin depender de máquinas potentes ni incurrir en altos costes de mantenimiento.

Principal ventaja profesional

Su eficiencia extrema y portabilidad: permite convertir cualquier dispositivo Linux básico (como una Raspberry Pi Zero o un microcontrolador de 10$) en un nodo de IA operativo con un tiempo de arranque inferior a un segundo y una huella de memoria un 99% inferior a alternativas basadas en TypeScript o Python.

Para quién no es

No es adecuado para usuarios finales sin conocimientos técnicos que busquen una solución "llave en mano" con interfaz comercial pulida, ni para empresas que requieran un entorno de producción crítico y certificado (v1.0 aún no alcanzada). Se descartará por perfiles que prefieran herramientas SaaS centralizadas o que no se sientan cómodos gestionando archivos de configuración JSON y entornos CLI.

Funcionalidades clave

- Soporte nativo de MCP (Model Context Protocol): integración con cualquier servidor MCP para extender las habilidades del agente.

- Enrutamiento inteligente de modelos (Smart Routing): capacidad de enviar consultas simples a modelos económicos y tareas complejas a LLMs avanzados para optimizar costes de API.

- Visión Multimodal: procesamiento de imágenes y archivos mediante tuberías de entrada directa para LLMs con capacidad de visión.

- Memoria a largo plazo: almacenamiento estructurado en JSONL y archivos Markdown para mantener el contexto del usuario y del agente.

- Pipeline de seguridad: sandbox configurable que restringe la ejecución de comandos y acceso a archivos únicamente al espacio de trabajo definido.

Precios

- Versión gratuita: La herramienta es de código abierto (Open Source) bajo licencia MIT. No tiene coste de licencia por uso.

- Rango de precios: 0€ (software). El coste asociado es el de las API de los modelos de lenguaje utilizados (OpenAI, Anthropic, DeepSeek, etc.) y el hardware mínimo necesario.

Perfil del usuario

- Empresas de IoT y Smart Cities que necesitan lógica de IA en el borde (Edge).

- Departamentos de DevOps para automatización de tareas de mantenimiento en servidores mediante agentes ligeros.

- Desarrolladores de sistemas embebidos (RISC-V, ARM).

- Profesionales de ciberseguridad para monitorización distribuida de bajo coste.

Nivel técnico requerido

- Uso: Intermedio. Requiere familiaridad con interfaces de chat (Telegram/Discord) o terminal (TUI).

- Instalación/Configuración: Alto. Es necesario manejo de terminal Linux, gestión de archivos JSON y configuración de variables de entorno.

- Conocimientos necesarios: Manejo de claves API, conceptos básicos de Docker (opcional) y administración básica de sistemas Linux.

Ejemplos de uso profesional

- Mantenimiento automatizado de servidores: Un agente desplegado en un NanoKVM que monitoriza logs y sugiere o ejecuta correcciones tras aprobación.

- Asistente de ingeniería Full-Stack: Integración con Git para explicar commits, realizar revisiones de código ligeras o automatizar despliegues mediante comandos

execsupervisados. - Pasarela de IA para equipos: Centralización de múltiples modelos de IA (DeepSeek, GPT-4, Claude) en un único canal de comunicación corporativo (WeCom, DingTalk).

- Nodo de monitoreo inteligente: Uso en cámaras o sensores para filtrar eventos relevantes antes de enviarlos a la nube oficial.

Uso y distribución

- Versión web: Incluye un WebUI Launcher para configuración y chat desde el navegador.

- Versión escritorio: Soporte para Windows y Linux con interfaz en la bandeja del sistema (System Tray).

- Versión móvil: Aplicación nativa Android (APK) y soporte para Termux.

- CLI: Binario único autocontenido de alto rendimiento.

- Arquitecturas soportadas: RISC-V, ARM (v7 y v8), MIPS y x86_64.

Open source

Proyecto bajo licencia MIT, permitiendo la modificación y uso comercial sin restricciones significativas.

Integraciones

- Facilidad de integración: Media-Alta (orientado a desarrolladores).

- Canales nativos: Telegram, Discord, WhatsApp, Matrix, Slack, WeCom, DingTalk, Feishu, LINE, QQ e IRC.

- Proveedores de LLM: Soporte para más de 30 proveedores (OpenAI, Anthropic, Google Gemini, OpenRouter, DeepSeek, Ollama, Azure, entre otros).

- Protocolos: Soporte nativo de MCP para conexión con herramientas externas y base de datos de "habilidades" (skills) personalizables.

Notas finales

Información legal, licencias y contratos

- El software se entrega "tal cual" bajo licencia MIT.

- Nota de seguridad: Actualmente en fase de desarrollo rápido (v0.2.x). Los desarrolladores advierten no desplegar en entornos de producción crítica debido a posibles problemas de seguridad en la red aún no resueltos.

Otros

- El proyecto destaca por ser "AI-Bootstrapped": un 95% de su código base en Go fue generado por una IA y refinado por humanos.

- Es una alternativa extremadamente eficiente a proyectos como OpenClaw o NanoBot.

Para más información:

- Sitio web oficial: https://picoclaw.io

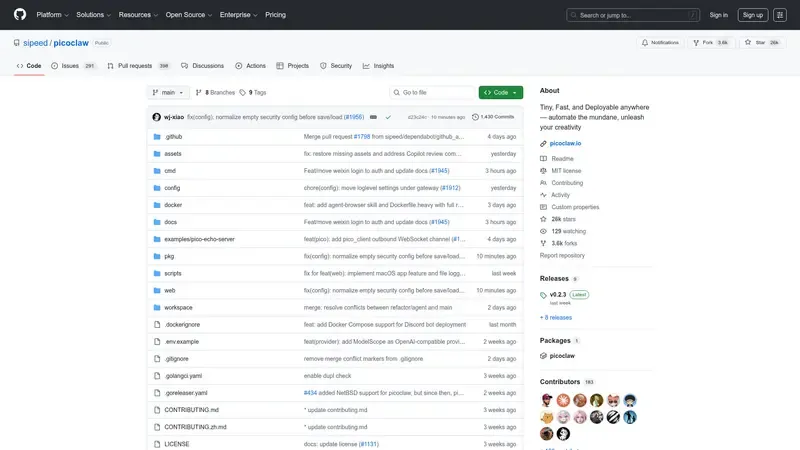

- Github: https://github.com/sipeed/picoclaw

- Documentación: https://docs.picoclaw.io

- Discord: https://discord.com/invite/sipeed

Aplicación profesional

PicoClaw se posiciona como una solución de infraestructura para empresas de servicios tecnológicos, desarrollo de hardware IoT y departamentos de sistemas. Es ideal para organizaciones que operan infraestructuras distribuidas (Edge Computing) o que necesitan automatizar tareas de administración de sistemas sin el coste de computación de frameworks pesados como LangChain. El presupuesto de implementación es mínimo (hardware desde 10€), centrándose el coste en el consumo selectivo de APIs de modelos de lenguaje. Sus puntos clave son la soberanía operativa en dispositivos locales, el cumplimiento de políticas de seguridad mediante sandboxing y la orquestación de múltiples modelos (LLM) para optimizar costes operativos (Smart Routing).

Madurez digital requerida

- Usuarios: Requiere perfiles técnicos capaces de interactuar con interfaces de línea de comandos (CLI), editar archivos de configuración estructurados (JSON) y gestionar claves API de forma segura.

- Empresa: El entorno debe estar familiarizado con la gestión de contenedores o despliegues en Linux y tener una gobernanza clara sobre el uso de tokens de IA para evitar costes imprevistos.

Plan orientativo de implantación

Pasos necesarios y estimaciones

- Evaluación inicial y diseño (1-3 días): Definición de los casos de uso (ej. monitoreo de logs, asistente técnico de campo) y selección de hardware (RISC-V, ARM, x86_64).

- Configuración y Prueba de Concepto (3-5 días): Despliegue del binario único, configuración de proveedores de LLM y establecimiento de límites en el sandbox de seguridad.

- Integración de Habilidades (1-2 semanas): Conexión con servidores MCP (Model Context Protocol) para dotar al agente de herramientas específicas y configuración de los canales de comunicación (Telegram, Slack, etc.).

- Validación y Ajuste (1 semana): Monitorización del comportamiento de los agentes autónomos frente a tareas locales y ajuste de los archivos de memoria (JSONL/Markdown).

Necesidades de formación del equipo

Es indispensable que el equipo técnico domine la estructura de los servidores MCP para extender las capacidades del agente. Se requiere capacitación específica en la gestión de variables de entorno y en la creación de "skills" personalizadas mediante el uso de comandos ejecutables seguros.

Perfiles necesarios

- Perfiles técnicos: Ingenieros de DevOps o Administradores de Sistemas Linux para el despliegue y mantenimiento de los nodos.

- Personal externo recomendado: Consultores especializados en arquitectura de Agentes IA para la definición de pipelines de razonamiento complejos.

- Otros: Desarrolladores de sistemas embebidos si el despliegue es en hardware propietario o crítico.

Retorno de la inversión

- El retorno es casi inmediato en términos de ahorro de hardware y energía en comparación con alternativas basadas en contenedores pesados.

- Se mide a través de la reducción de latencia en procesos de borde, la disminución en la factura mensual de APIs mediante el enrutamiento inteligente (utilizando modelos pequeños para tareas triviales) y la mejora en el tiempo de respuesta (MTTR) en tareas de mantenimiento automatizadas.

Otros

PicoClaw destaca por su portabilidad extrema, permitiendo su ejecución en dispositivos con tan solo 10MB de RAM, lo que habilita la IA en entornos donde antes era técnicamente imposible. Su arquitectura basada en Go garantiza un rendimiento nativo sin las dependencias de entornos de ejecución como Python o Node.js. Al estar en fase de desarrollo (v0.2.x), se recomienda su uso en redes privadas o perímetros controlados mientras se estabilizan los protocolos de seguridad de red.

foia## Principales recomendaciones

- Entorno de pruebas: No despliegue esta tecnología en entornos de producción crítica. El fabricante advierte que se encuentra en una fase temprana de desarrollo (v0.2.x) con posibles problemas de seguridad de red no resueltos.

- Gestión de API Keys: Asegúrese de configurar correctamente el archivo

.security.yml. El sistema separa las claves de API (datos sensibles) del archivo de configuración general (config.json) para evitar filtraciones accidentales al compartir configuraciones. - Control de Workspace: Utilice el "Pipeline de seguridad" (sandboxing) para restringir el acceso del agente exclusivamente a las carpetas necesarias, evitando que la IA pueda leer o modificar archivos sensibles del sistema operativo.

- Supervisión de comandos: Al usar funciones de ejecución (

exec), mantenga siempre la supervisión humana activa para validar los comandos sugeridos por la IA antes de su ejecución en servidores.

Ley de Inteligencia Artificial (AI Act)

- Clasificación: Bajo el marco de la UE, esta herramienta se clasifica generalmente como un sistema de IA de propósito general (GPAI). Al ser de código abierto y distribuida bajo licencia libre (MIT), goza de ciertas excepciones en transparencia, a menos que presente riesgos sistémicos.

- Transparencia: Si la empresa utiliza este agente para interactuar con clientes o empleados, debe informar claramente de que están interactuando con una IA.

- Uso en infraestructuras críticas: Debido a su estado de desarrollo temprano, su uso para gestionar infraestructuras críticas (Sector Público, Energía, Salud) podría elevar su clasificación de riesgo según el AI Act, exigiendo auditorías que el software aún no cumple.

Privacidad y protección de datos

- Responsabilidades: La empresa usuaria actúa como Responsable del Tratamiento. Sipeed (el desarrollador) no tiene acceso a los datos, ya que el procesamiento es 100% local.

- Ubicación de los datos: Los datos (logs, base de datos SQLite, memoria JSONL) se almacenan localmente en el hardware de la empresa. No hay transmisión a servidores de Sipeed.

- Transferencia internacional: Al configurar proveedores de LLM externos (OpenAI, Anthropic, etc.), se produce una transferencia internacional de datos. Es obligatorio firmar un DPA (Data Processing Agreement) con dichos proveedores y verificar que cumplen con el RGPD.

- Derechos ARCO: Al ser una base de datos local (SQLite), la empresa puede atender fácilmente peticiones de acceso, rectificación o supresión eliminando los registros correspondientes en el sistema de archivos local.

Propiedad intelectual

- Propiedad de datos: La empresa conserva la propiedad total de los datos de entrada y del contexto almacenado en el dispositivo.

- Licencia: Distribuido bajo Licencia MIT, lo que permite a la empresa española modificar, copiar y comercializar el software, incluso integrándolo en productos cerrados, siempre que se mantenga el aviso de copyright original.

Usos y prohibiciones

- Usos admitidos: Automatización de DevOps, monitorización de nodos IoT, asistentes de programación locales y procesamiento de datos en el "Edge" (borde de la red).

- Usos prohibidos: No debe utilizarse para la creación de criptomonedas o tokens (el fabricante denuncia activamente estafas en este sentido). No se recomienda para gestionar datos médicos o financieros de alta sensibilidad en su versión actual.

Seguridad y certificaciones

- Seguridad: Incluye un mecanismo de "cron security gating" y filtrado de datos sensibles en los logs.

- Certificaciones: No consta que posea certificaciones ISO 27001 o Esquema Nacional de Seguridad (ENS). Es un proyecto de comunidad Open Source en fase beta.

Otros

- Origen del código: El 95% del código ha sido generado por IA (AI-bootstrapped). Esto requiere una revisión manual exhaustiva por parte del departamento de IT de la empresa para detectar posibles vulnerabilidades no intencionadas en el código fuente de Go.