Fabric es un framework de código abierto diseñado para profesionales técnicos, desarrolladores y analistas que buscan integrar la IA en su flujo de trabajo diario mediante la organización de Patterns. Esta herramienta permite automatizar tareas granulares como resumir reuniones, analizar código y extraer ideas de vídeos directamente desde la línea de comandos. Es ideal para quienes desean aplicar una filosofía modular tipo Unix a la inteligencia artificial, optimizando la eficiencia sin depender de interfaces web lentas.

Análisis de Tendencia

Evolución del interés y popularidad en el mercado.

Qué y para quién es

Fabric es un framework de código abierto diseñado para integrar la Inteligencia Artificial en el flujo de trabajo diario mediante la organización de "Patterns" (prompts optimizados). A diferencia de los chatbots convencionales, Fabric se enfoca en resolver problemas específicos y repetitivos a través de la línea de comandos o integraciones, permitiendo que el usuario aplique IA a tareas granulares como resumir reuniones, extraer ideas de vídeos o analizar código de forma modular y sistemática. Está dirigido a profesionales que buscan eficiencia técnica, especialmente en sectores tecnológicos, ciberseguridad y creación de contenido.

Principal ventaja profesional

La capacidad de atomizar tareas complejas en componentes manejables mediante una biblioteca de prompts curados por la comunidad (Patterns), que pueden ejecutarse directamente desde la terminal o integrarse en pipelines de automatización sin depender de interfaces web lentas o manuales.

Para quién no es

No es una herramienta para usuarios que prefieren interfaces puramente visuales (GUI) o que no tienen familiaridad básica con la línea de comandos. Tampoco es ideal para organizaciones que prohíben el uso de herramientas de terceros para gestionar claves de API o que carecen de infraestructura para ejecutar software local o en contenedores.

funcionalidades clave

- Sistema de Patterns: Biblioteca de prompts estructurados para tareas específicas (extracción de sabiduría de vídeos, escritura de ensayos, análisis de vulnerabilidades, etc.).

- Arquitectura Modular: Capacidad de encadenar prompts para que la salida de uno sea la entrada del siguiente (filosofía Unix).

- Soporte Multi-modelo: Integración nativa con OpenAI, Anthropic, Azure AI, Google Vertex AI, AWS Bedrock y modelos locales vía Ollama.

- Capacidad de transcripción: Soporte integrado para conversión de voz a texto y procesamiento de archivos multimedia.

- Servidor REST API: Posibilidad de exponer las funcionalidades de Fabric como un servicio web para integraciones personalizadas.

Precios

- Versión gratuita: La herramienta es Open Source bajo licencia MIT, totalmente gratuita para su descarga, modificación y uso comercial.

- Costes asociados: El usuario debe costear el consumo de tokens de las API de los proveedores de LLM utilizados (OpenAI, Anthropic, etc.) o disponer de hardware para modelos locales.

Perfil del usuario

- Analistas de ciberseguridad y profesionales de IT.

- Desarrolladores de software y arquitectos de sistemas.

- Creadores de contenido y analistas de datos.

- Perfiles con mentalidad de automatización y eficiencia.

Nivel técnico requerido

- Nivel técnico de uso: Medio (requiere manejo de terminal y conceptos básicos de IA).

- Nivel técnico de instalación: Medio-Alto (instalación vía scripts de Shell/PowerShell, Go o Docker).

- Conocimientos necesarios: Manejo de variables de entorno, gestión de claves API y fundamentos de CLI (Command Line Interface).

Ejemplos de uso profesional

- Generación de resúmenes ejecutivos a partir de transcripciones de reuniones de Microsoft 365.

- Análisis automático de repositorios de código para detectar malas prácticas o documentar funciones.

- Creación de hilos de redes sociales o artículos a partir de esquemas técnicos o ideas sueltas.

- Extracción de puntos de acción y "insights" clave de conferencias o vídeos de formación técnica.

Uso y distribución

- Versión web: Dispone de una Web App propia para gestión visual de patrones.

- Versión escritorio: Compatible con Windows (Winget), macOS (Homebrew) y Linux (AUR).

- Contenedores: Imagen oficial disponible en Docker Hub y GHCR para despliegues aislados o en servidor.

- CLI: Interfaz principal optimizada para terminales modernas.

Open source

Licencia MIT (permisiva), permitiendo uso comercial, distribución y modificación privada sin restricciones significativas.

Integraciones

- Facilidad de integración: Alta para perfiles técnicos (Full-code/CLI) y media para automatización No-code mediante su API REST.

- API propia: Dispone de servidor API con documentación interactiva Swagger/OpenAPI.

- Integraciones nativas: Soporte para Microsoft 365 Copilot, Azure Entra ID (autenticación empresarial) y GitHub Models.

- Conectividad modular: Diseñado para funcionar como una utilidad de sistema que se integra mediante "pipes" con otras herramientas de línea de comandos.

Notas finales

información legal, licencias, contratos

- El software se entrega "tal cual", sin garantías explícitas, bajo el modelo MIT. La propiedad de los inputs y outputs generados depende de los términos de servicio del proveedor de IA elegido (OpenAI, Anthropic, etc.).

Otros

- El proyecto mantiene una velocidad de desarrollo muy alta, con actualizaciones frecuentes de soporte para los últimos modelos del mercado (ej. Claude 4.5, OpenAI Codex).

Para más información:

- Sitio web oficial: https://danielmiessler.com/p/fabric-origin-story

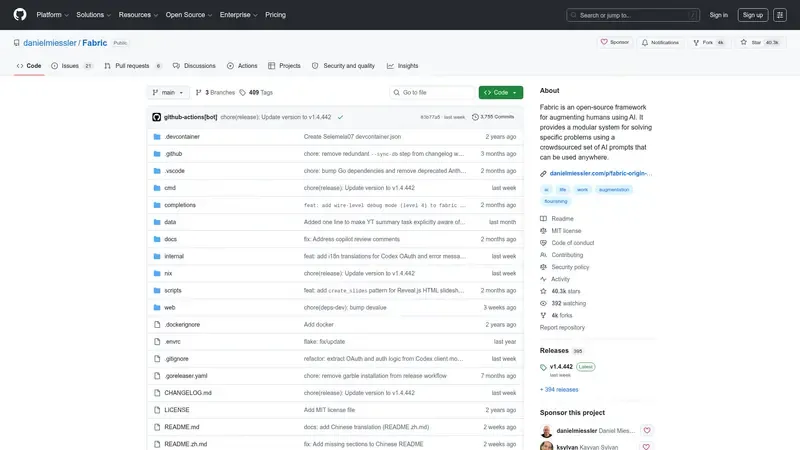

- Github: https://github.com/danielmiessler/fabric

- Documentación Wiki: https://github.com/danielmiessler/fabric/blob/main/docs/index.md

- Historial de cambios: https://github.com/danielmiessler/fabric/blob/main/CHANGELOG.md

Aplicación profesional

Fabric es un framework de alta eficiencia orientado a empresas de servicios IT, consultoras tecnológicas y departamentos de I+D. Su aplicación principal radica en la estandarización de procesos mediante la automatización de la "ingeniería de prompts". El presupuesto es bajo en infraestructura, ya que es software libre, pero requiere una inversión operativa en consumo de API (OpenAI, Anthropic) o hardware especializado para modelos locales (Ollama). Los puntos clave son la reducción de tiempos en tareas de análisis de texto, documentación técnica automática y la eliminación del "copia-pega" constante en interfaces web de IA.

Madurez digital requerida

- Usuarios: Familiarizados con la terminal (CLI), gestión de variables de entorno y comprensión básica de cómo funcionan los LLM (tokens, contexto).

- Empresa: Organizaciones con políticas claras sobre el uso de sombras de IT (Shadow AI) y gestión segura de claves API. Debe existir una cultura de automatización y uso de herramientas de código abierto.

Plan orientativo de implantación

Pasos necesarios y estimaciones

- Evaluación inicial (1 semana): Identificación de flujos de trabajo repetitivos (resúmenes de reuniones, análisis de logs, redacción de informes) que puedan atomizarse en patrones.

- Instalación y configuración (1-3 días): Despliegue del entorno en Go, configuración de proveedores de modelos (OpenAI, Claude, local) y centralización de claves API en gestores seguros.

- Prueba de concepto (2 semanas): Selección de un departamento (ej. Ciberseguridad o Desarrollo) para aplicar patrones específicos como "analyze_vulnerability" o "create_summary".

- Despliegue y escalado (Continuo): Creación de patrones personalizados propios de la empresa y exposición mediante el servidor API de Fabric para conectarlo con otras herramientas internas.

Necesidades de formación del equipo

El personal debe ser capacitado en la filosofía "Unix pipes" (conectar la salida de un comando con la entrada de otro) y en la edición de archivos YAML/Markdown para la creación de Patterns propios. No es necesaria formación en programación profunda, pero sí en lógica de flujos de trabajo.

Perfiles necesarios

- Perfiles técnicos: Administradores de sistemas o DevOps para la instalación y mantenimiento de los contenedores o entornos Go.

- Personal externo: Consultores en IA generativa para optimizar la biblioteca de prompts (Patterns) si la empresa no tiene experiencia previa.

- Otros: Líderes de equipo con capacidad para identificar dónde se pierde tiempo en tareas manuales de gestión de información.

Retorno de la inversión

- Tiempos: Se estima una reducción del 60-80% en el tiempo dedicado al procesamiento de información masiva (transcripciones, lectura de hilos de Slack, revisión de código).

- KPIs: Número de patrones ejecutados por semana, reducción de horas hombre en generación de informes y latencia en la entrega de resúmenes ejecutivos.

Otros

- La seguridad es un factor crítico; al ser una herramienta que se ejecuta localmente o en servidores controlados, evita el envío accidental de datos a interfaces públicas, siempre que se utilicen modelos locales u operativos bajo contratos de privacidad empresarial con proveedores de API.

- La comunidad aporta patrones nuevos casi semanalmente, lo que permite a la empresa mantenerse actualizada en técnicas de IA sin desarrollar soluciones desde cero.

Informe técnico descriptivo

Principales recomendaciones

- Gestión de claves API: El usuario es el único responsable de custodiar las llaves de acceso (OpenAI, Anthropic, etc.). No las comparta ni las incluya en repositorios públicos.

- Configuración local vs. nube: Priorice la ejecución de modelos locales (vía Ollama) cuando trabaje con datos sensibles o protegidos por el RGPD para evitar transferencias internacionales de datos.

- Auditoría de "Patterns": Antes de usar un patrón de la comunidad, revise el contenido del archivo

system.mdpara asegurarse de que no envía información corporativa a destinos no deseados. - Uso de Tuberías (Pipes): Tenga precaución al encadenar comandos; la salida de un proceso (que puede contener datos personales) será la entrada del modelo de IA.

Privacidad y protección de datos

- Responsabilidades: Fabric es una herramienta de intermediación ("framework"). La responsabilidad legal sobre los datos recae en la empresa usuaria (Responsable del Tratamiento) y en el proveedor del modelo de IA (Encargado del Tratamiento).

- Ubicación de los datos: Si se usan modelos en la nube, la ubicación depende del proveedor elegido. Si se usa localmente mediante Ollama, los datos permanecen en el perímetro de la empresa.

- Transferencia internacional: El uso de APIs comerciales (OpenAI, Anthropic) suele implicar la transferencia de datos a EE.UU., lo que requiere verificar la adhesión del proveedor al Marco de Privacidad de Datos UE-EE.UU.

- Derechos ARCO: Al ser una herramienta CLI, no almacena datos personales de terceros de forma persistente más allá de los logs locales o el historial del terminal.

Propiedad intelectual

- Propiedad de las entradas (Inputs): La empresa española mantiene la propiedad de los datos suministrados a la herramienta, según la legislación de Propiedad Intelectual vigente.

- Propiedad de los resultados (Outputs): El software se distribuye bajo licencia MIT, que no reclama derechos sobre los resultados. Sin embargo, la保護 (protección) por derechos de autor del contenido generado por IA en España es limitada, ya que la ley requiere intervención humana creativa.

Usos y prohibiciones

- Usos admitidos: Automatización de flujos de trabajo, análisis de código interno, creación de resúmenes de reuniones propias y análisis de vulnerabilidades técnicas.

- Usos prohibidos: No utilizar para procesar datos de categorías especiales (salud, religión, biometría) a través de APIs de terceros sin un Análisis de Impacto (EIPD) previo. Prohibido el uso para vigilancia masiva o perfiles discriminatorios según la AI Act.

Seguridad y certificaciones

- Seguridad: Al ser Open Source, el código es auditable. El sistema no incluye por defecto cifrado de extremo a extremo, ya que depende del canal de comunicación de la API del proveedor de IA.

- Certificaciones: El framework no cuenta con certificaciones ISO o Esquema Nacional de Seguridad (ENS) por sí mismo; el cumplimiento de estas normas dependerá de la infraestructura donde se despliegue (ej. Azure, AWS o servidor propio).

Otros

- Confusión de marca: No debe confundirse este software (framework de prompts) con "Microsoft Fabric" (plataforma de datos empresarial), el cual tiene condiciones legales y de privacidad de nivel corporativo totalmente distintas.