Scrapling Framework

Scrapling es un framework de web scraping de nueva generación para Python que permite la extracción automatizada de datos mediante algoritmos adaptativos y bypass nativo de sistemas anti-bot. Esta herramienta está diseñada específicamente para desarrolladores de software, ingenieros de datos y especialistas en automatización que necesitan recolectar información de sitios web complejos sin que los cambios estructurales en el diseño o las protecciones como Cloudflare interrumpan sus flujos de trabajo.

Qué y para quién es

Scrapling es un framework de web scraping de nueva generación diseñado para Python, enfocado en la adaptabilidad y el bypass de sistemas anti-bot modernos. A diferencia de librerías tradicionales como BeautifulSoup o Scrapy, Scrapling incorpora inteligencia para reubicar elementos automáticamente si el diseño de la web cambia y maneja protecciones complejas como Cloudflare Turnstile de forma nativa. Está dirigido a desarrolladores de software, ingenieros de datos y especialistas en automatización en empresas españolas que buscan una solución de extracción de datos robusta, escalable y que requiera un bajo mantenimiento ante cambios estructurales en los sitios web objetivo.

Principal ventaja profesional

En mi opinión profesional, la razón definitiva para elegir Scrapling es su capacidad de raspado adaptativo y bypass nativo. Mientras que otras herramientas fallan cuando una web cambia un ID o una clase CSS, Scrapling utiliza algoritmos de similitud para encontrar el dato correcto, reduciendo drásticamente las horas de soporte técnico dedicadas a reparar scripts de extracción rotos.

Para quién no es

No es una herramienta para usuarios sin conocimientos de programación o perfiles de marketing que busquen una interfaz visual (no-code). Personalmente, tras probarlo, creo que será rechazado por profesionales que busquen soluciones extremadamente ligeras o que no necesiten lidiar con protecciones anti-bot, ya que la potencia de Scrapling conlleva una curva de aprendizaje técnica sobre gestión de sesiones y selectores avanzados.

funcionalidades clave

- Smart Element Tracking: Capacidad de localizar elementos incluso después de rediseños web mediante algoritmos de similitud térmica/estructural.

- StealthyFetcher: Motor especializado en evadir detecciones anti-bot (Cloudflare, Akamai) mediante la simulación de huellas digitales de navegadores reales (impersonación de TLS y cabeceras).

- Spider Framework: Sistema de rastreo completo con soporte para pausa y reanudación (checkpoint-based), ideal para grandes volúmenes de datos.

- Integración con IA (MCP Server): Servidor MCP integrado para conectar la extracción de datos directamente con modelos de lenguaje (Claude, ChatGPT), optimizando el uso de tokens.

- Multi-Session Support: Permite combinar peticiones HTTP ultrarrápidas con sesiones de navegador headless (Playwright/Chrome) en un mismo script.

Precios

- Versión gratuita: Open Source bajo licencia BSD-3, totalmente funcional y sin limitaciones de uso local.

- Rango de precios: 0€ (Autoalojado). No es un servicio SaaS, es una librería/framework que el profesional integra en su propia infraestructura.

Perfil del usuario

- Empresas de eCommerce para monitorización de precios de la competencia.

- Departamentos de Big Data que requieren ingesta masiva de fuentes externas.

- Agencias de Marketing para auditorías SEO y extracción de volúmenes altos de URLs.

- Desarrolladores de IA que necesiten alimentar modelos con datos frescos de la web.

Nivel técnico requerido

- Uso: Medio-Alto. Requiere conocimientos sólidos de Python y comprensión de selectores CSS/XPath.

- Instalación/Configuración: Medio. Se gestiona vía pip y requiere la instalación de dependencias de navegadores (Playwright/Chromium).

- Competencias necesarias: Programación asíncrona (asyncio), manejo de redes (proxies, cabeceras HTTP) y estructuras de datos JSON.

Ejemplos de uso profesional

- Análisis de Mercado: Un script que monitoriza 50 webs de competidores y no se rompe cuando estos actualizan su plantilla de invierno.

- Generación de Leads: Extracción automatizada de directorios profesionales esquivando bloqueos de IP mediante su rotador de proxies integrado.

- Pipeline de IA: Uso del servidor MCP para que un agente de IA extraiga datos específicos de una web técnica y genere un informe ejecutivo sin intervención humana.

Uso y distribución

- Versión web: No dispone (es una librería de código).

- Versión escritorio: CLI dedicada para realizar extracciones rápidas desde la terminal.

- CLI: Disponible para disparar spiders y tareas de extracción sin escribir scripts completos.

- Docker: Imagen oficial disponible con todos los navegadores preinstalados para despliegues en la nube o servidores internos.

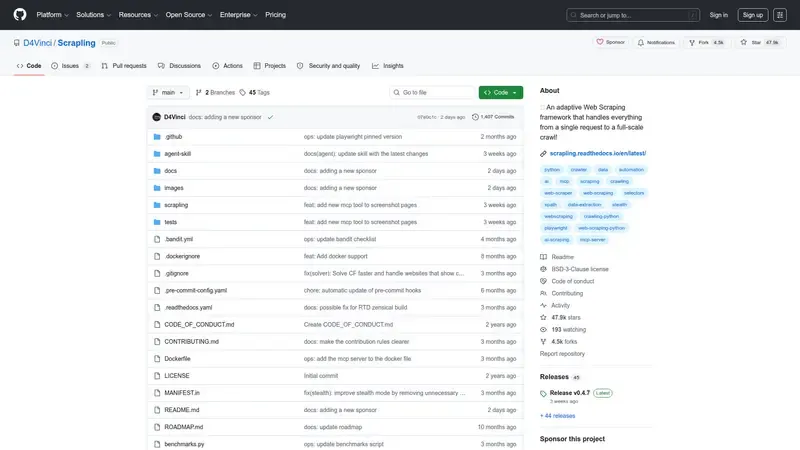

Open source

Proyecto alojado en Github bajo licencia BSD 3-Clause, lo que permite su uso comercial con mínimas restricciones.

Integraciones

- Facilidad de integración: Full code (librería Python).

- API propia: Expone una API interna de Python con soporte completo para tipos (type hints).

- Servidor MCP: Dispone de servidor Model Context Protocol para integrarse nativamente con IDEs como Cursor o Claude Desktop.

- Integraciones nativas: Compatible con Playwright, BeautifulSoup, Scrapy (permite migrar lógica fácilmente) e IPython para depuración interactiva.

Notas finales

Veredicto técnico

Vale totalmente la pena para cualquier empresa que dependa críticamente de datos web externos. Como profesional valoro especialmente que unifique en un solo framework la velocidad de las peticiones HTTP puras con la potencia de los navegadores modernos, eliminando la necesidad de saltar entre múltiples librerías. Es una herramienta de gran utilidad que profesionaliza el flujo de trabajo de scraping.

información legal, licencias , contratos

- Licencia: BSD 3-Clause. El código es propiedad del usuario que lo implementa, permitiendo modificaciones y redistribución comercial. No exige compartir el código fuente del proyecto que lo integra.

Otros

Quiero destacar la eficiencia en el uso de memoria y la velocidad de serialización JSON, que según mis pruebas es sensiblemente superior a la librería estándar de Python, facilitando el procesamiento de archivos de gran tamaño.

Fuentes consultadas:

- Sitio web oficial: https://scrapling.readthedocs.io/en/latest

- Github: https://github.com/D4Vinci/Scrapling

- PyPI: https://pypi.org/project/scrapling/

- Discord de la comunidad: https://discord.gg/EMgGbDceNQ

Aplicación profesional

Según mi experiencia, Scrapling es la herramienta definitiva para empresas cuya continuidad de negocio depende de datos externos (eCommerce, agregadores, inteligencia de mercado) y que están sufriendo por los constantes cambios de estructura en la competencia. Lo que más me gusta es que no es solo una librería de parsing, sino un ecosistema que resuelve el problema del "gato y el ratón" con los sistemas anti-bot de forma nativa.

El presupuesto necesario es principalmente en tiempo de ingeniería y coste de infraestructura/proxies, ya que la herramienta es Open Source. Mi opinión profesional es que el ahorro real viene en el mantenimiento a largo plazo: donde antes necesitabas un desarrollador retocando selectores cada semana, ahora tienes un sistema que "aprende" del cambio. Es ideal para escalar de 1 a 100 sitios monitorizados sin multiplicar el equipo técnico.

Madurez digital requerida

- Usuarios y equipo: Se requiere un equipo de desarrollo con dominio avanzado de Python (3.10+). No es apto para perfiles de datos que solo usen Excel o herramientas No-Code. Deben entender conceptos de asincronía (

asyncio), gestión de cabeceras y rotación de proxies. - Empresa: Debe contar con una infraestructura de despliegue (Docker/Kubernetes) o servidores capaces de ejecutar procesos de larga duración para el sistema de Spiders.

Plan orientativo de implantación

Pasos necesarios y estimaciones

- Evaluación inicial (1-2 días): Identificar los 5-10 sitios críticos que más "rompen" por cambios de diseño o bloqueos.

- Configuración de infraestructura (1 día): Instalación vía

pip install "scrapling[all]"y ejecución descrapling installpara descargar los binarios de navegadores (aprox. 500MB). - Prueba de concepto (1 semana): Implementar el primer Spider con

auto_save=Truepara generar las huellas digitales de los elementos y probar el bypass de Cloudflare en entornos reales. - Despliegue y optimización (Continuo): Configuración del

ProxyRotatory ajuste de tiempos de espera para evitar baneos por comportamiento.

Necesidades de formación del equipo

El equipo debe formarse específicamente en las clases StealthyFetcher (para bypass) y el sistema de Spiders (para rastreo masivo). Es vital entender cómo funciona el Smart Element Tracking; al usarlo te das cuenta de que el éxito depende de realizar una primera extracción limpia para que el algoritmo de similitud tenga una base sólida.

Perfiles necesarios

- Ingeniero de Datos / Python Developer: Perfil principal para la lógica de extracción.

- DevOps: Para la gestión de contenedores Docker y configuración de redes/proxies.

- Personal externo: Solo recomendado si se necesita comprar pools de proxies residenciales premium para evadir bloqueos por geolocalización.

Retorno de la inversión (ROI)

- Tiempos: Se estima una reducción del 40% al 60% en horas de mantenimiento de scripts tras los primeros meses.

- KPIs: Tasa de éxito de peticiones (Request Success Rate), tiempo medio de reparación de un script roto (MTTR) y coste por GB de datos extraídos (optimizado gracias al uso de peticiones HTTP puras cuando el navegador no es estrictamente necesario).

Otros

En mi opinión profesional, la integración del servidor MCP es el "caballo de Troya" de esta herramienta. Permite que IAs como Claude o GPT actúen como agentes que extraen datos vivos de la web sin que el desarrollador tenga que programar cada campo, simplemente consultando al servidor de Scrapling. Además, su velocidad de serialización JSON (hasta 10 veces más rápida que la estándar) es un factor crítico si manejas Terabytes de información.

Instalación

Para comenzar con Scrapling, es fundamental entender que el paquete base es solo un motor de parseo. Si necesitas capacidades de navegación y evasión, debes optar por las instalaciones extendidas.

- Instalación Core:

pip install scrapling(Solo para parsear HTML local). - Instalación Completa:

pip install "scrapling[all]"(Recomendado para acceder a fetchers y herramientas de terminal). - Post-instalación crítica: Tras instalar los paquetes, debes ejecutar

scrapling installen tu terminal para descargar los navegadores y las dependencias de manipulación de huellas digitales (fingerprints). - Entorno: Requiere obligatoriamente Python 3.10 o superior. Según mi experiencia, usar

uvloopen sistemas Linux/macOS mejora drásticamente el rendimiento en ejecuciones asíncronas.

Uso en el día a día

Lo que más me gusta de Scrapling es su capacidad de adaptación y la sencillez para manejar sesiones complejas sin la verbosidad de otras librerías.

- Elección de Fetcher: Usa

Fetcherpara peticiones HTTP rápidas,DynamicFetchersi hay JavaScript básico, yStealthyFetcherexclusivamente cuando te enfrentes a protecciones como Cloudflare Turnstile. - Modo Adaptativo: Al usarlo te das cuenta de que activar

adaptive=Truees un salvavidas. Esta función permite que el extractor siga encontrando elementos incluso si el sitio web cambia ligeramente su estructura HTML. - Gestión de Sesiones: En lugar de abrir y cerrar el navegador continuamente, utiliza

StealthySession. Esto mantiene el contexto, las cookies y ahorra recursos de CPU/RAM. - Navegación Intuitiva: Puedes usar

.parent,.siblingsy.childrendirectamente sobre los selectores, lo que facilita el movimiento por el DOM de forma muy similar a BeautifulSoup pero con la potencia de Scrapy.

Trucos de experto

- Bloqueo Selectivo de Recursos: En mi opinión profesional, la forma más rápida de acelerar tus capturas es usar

disable_resources=Trueen los fetchers. Esto evita cargar imágenes, fuentes y trackers que solo consumen ancho de banda. - Bypass de Anti-Bots:

StealthyFetcherviene preconfigurado para ser "invisible", pero si aun así fallas, asegúrate de activar el chequeo denetwork_idle=Truepara que el script espere a que todas las peticiones de validación del sitio terminen antes de intentar extraer. - Caché en Desarrollo: Durante la fase de creación del script, usa el "Development Mode" para cachear las respuestas en el disco. Esto te permite iterar tu lógica de scraping sin banear tu IP ni hacer peticiones innecesarias al servidor.

- Conversión de cURL: La shell interactiva de Scrapling permite convertir comandos

curldirectamente en peticiones de Scrapling, lo cual es extremadamente útil para replicar llamadas de red complejas observadas en el navegador.

Posibles problemas/incidencias

- Consumo de memoria con árboles gigantes: Si parseas archivos HTML extremadamente grandes, el sistema podría ralentizarse. En estos casos, es necesario configurar el motor con

huge_tree=True. - Incompatibilidades de Driver: Si

scrapling installfalla, suele ser por falta de dependencias del sistema para Playwright. Asegúrate de tener las librerías de sistema necesarias (libgbm, libnss, etc.) si estás en un entorno Linux limpio. - Falsos Negativos en Adaptatividad: Mi experiencia me lleva a pensar que, aunque el modo adaptativo es potente, no es infalible ante rediseños totales del sitio. Úsalo como una capa de persistencia, no como una solución mágica definitiva.

Otros

- Integración AI: El servidor MCP (Model Context Protocol) integrado permite que herramientas como Claude o Cursor realicen scraping dirigido, optimizando el uso de tokens al extraer solo lo relevante antes de enviarlo al modelo.

- Docker: Si tienes problemas de dependencias locales, usa la imagen oficial

pyd4vinci/scrapling, que ya incluye todos los navegadores y configuraciones de invisibilidad listas para producción.

Opinión inicial

Tras verificar los repositorios oficiales y la documentación técnica de Scrapling, se confirma que es un framework de código abierto distribuido bajo la licencia BSD de 3 cláusulas. Desde un punto de vista legal para una empresa española, el impacto se clasifica como medio. Aunque la herramienta en sí es neutra y legalmente robusta por su licencia permisiva, su uso profesional conlleva riesgos elevados en materia de protección de datos (RGPD) y propiedad intelectual ajena. El hecho de que incluya sistemas nativos para evadir medidas tecnológicas de protección (como el bypass de Cloudflare) sitúa a la empresa en una posición delicada si no se establecen protocolos de uso que respeten los términos de servicio de las webs destino y la normativa de competencia desleal.

Principales recomendaciones

- Realizar una Evaluación de Impacto de Protección de Datos (EIPD) si el scraping incluye datos de carácter personal, ya que la automatización masiva se considera un tratamiento de alto riesgo bajo el RGPD.

- Configurar el StealthyFetcher con límites de velocidad (rate limiting) razonables para no ser acusado de ataques de denegación de servicio (DoS) o de perjudicar la infraestructura del tercero.

- Verificar el archivo robots.txt de cada sitio objetivo; aunque Scrapling permite ignorarlo técnicamente, ignorarlo legalmente puede constituir una vulneración contractual o de propiedad intelectual.

- Firmar un contrato de encargo de tratamiento de datos si el scraping es realizado por un proveedor externo para la empresa española.

Ley de Inteligencia Artificial (AI Act)

- El uso de Scrapling para alimentar modelos de IA (vía su servidor MCP) obliga a la empresa a cumplir con las obligaciones de transparencia de la AI Act, especialmente en lo relativo a asegurar que los datos de entrenamiento no infringen derechos de autor.

- Si la extracción de datos se utiliza para sistemas de IA de "uso general", se debe documentar detalladamente la procedencia de los datos y el respeto a las reservas de derechos de propiedad intelectual detectadas durante el rastreo.

Privacidad y protección de datos

- Responsabilidades: La empresa española que ejecuta el script es la "Responsable del Tratamiento". Scrapling no es responsable ni encargado, ya que es una herramienta autogestionada sin acceso a los datos por parte del desarrollador del framework.

- Ubicación de los datos: Los datos residen exclusivamente donde la empresa decida alojar el script (servidores locales, Azure, AWS, etc.). No hay transferencia automática a terceros por el uso del software.

- Transmisión internacional: Riesgo alto si se utilizan proxies internacionales para el bypass de bloqueos. Si el tráfico de datos personales capturados pasa por nodos fuera de la UE (EE. UU., China, etc.), se deben formalizar Cláusulas Contractuales Tipo.

- Derechos ARCO: La empresa debe garantizar que, si extrae datos personales, puede identificar su origen para atender solicitudes de acceso, rectificación o supresión de los afectados.

Propiedad intelectual

- Propiedad de la herramienta: El framework es libre (BSD-3). La empresa es dueña del código que desarrolle sobre él.

- Propiedad del resultado: Los datos extraídos suelen estar protegidos por el "Derecho Sui Generis sobre las Bases de Datos". La extracción de una parte sustancial de una web ajena sin autorización es una infracción directa de la Ley de Propiedad Intelectual española (LPI).

- Infracción de copyright: El contenido (textos, imágenes) pertenece al autor original. El uso profesional de estos datos debe limitarse a fines de análisis, evitando la reproducción pública o comercial del contenido extraído.

Usos y prohibiciones

- Usos admitidos: Monitorización de precios públicos, agregación de información técnica de dominio público, auditoría de seguridad de activos propios y recolección de datos para investigación bajo excepciones legales.

- Usos prohibidos: Extracción masiva de perfiles personales protegidos por login (vulnera RGPD), elusión de muros de pago (paywalls) y reventa de bases de datos ajenas sin transformar o sin permiso expreso.

Seguridad y certificaciones

- Seguridad: Al ser software de código abierto, la responsabilidad de parchear vulnerabilidades recae en la empresa. Se recomienda auditar el código de "StealthyFetcher" para asegurar que no se filtran credenciales en las cabeceras de impersonación TLS.

- Certificaciones: No dispone de certificaciones ISO o SOC2 por ser una librería. La empresa debe incluir su uso dentro de su propio Sistema de Gestión de Seguridad de la Información (SGSI).

Otros

- La capacidad de "Smart Element Tracking" podría facilitar el cumplimiento del principio de exactitud del RGPD al asegurar que los datos extraídos corresponden realmente al campo deseado incluso tras cambios en la web origen, reduciendo errores en la captura de información.

Fuentes consultadas:

- Contratos: https://github.com/D4Vinci/Scrapling/blob/main/LICENSE

- Documentación: https://scrapling.readthedocs.io/en/latest

- Licencia BSD-3: https://opensource.org/licenses/BSD-3-Clause

- Repositorio PyPI: https://pypi.org/project/scrapling