ArtificialAnalysis.ai

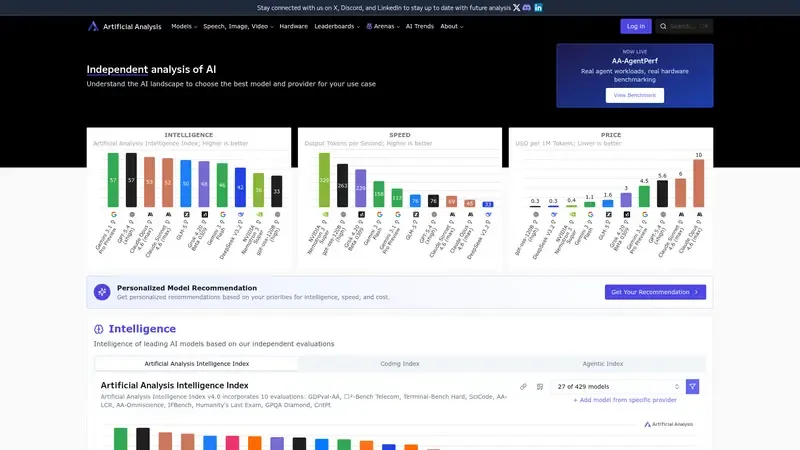

Plataforma de benchmarking independiente diseñada para CTOs, arquitectos de IA y desarrolladores que necesitan optimizar la selección de modelos de lenguaje, imagen y voz. Permite comparar objetivamente el rendimiento real frente al coste, analizando métricas críticas como tokens por segundo, latencia (TTFT) y precio por millón de tokens entre proveedores como OpenAI, Anthropic, Google y Meta, facilitando la toma de decisiones estratégicas basadas en datos técnicos y eficiencia operativa.

Análisis de Tendencia

Evolución del interés y popularidad en el mercado.

Qué y para quién es

Artificial Analysis es una plataforma independiente de benchmarking y análisis técnico de modelos de Inteligencia Artificial (LLM, generación de imagen, vídeo y voz). Está diseñada para ayudar a la toma de decisiones estratégicas en empresas que integran IA, permitiendo comparar modelos no solo por su "inteligencia" teórica, sino por métricas críticas de negocio: coste por millón de tokens, velocidad de salida (tokens/segundo) y latencia.

En el ámbito profesional, es un recurso esencial para CTOs, arquitectos de soluciones, desarrolladores de IA y responsables de producto que necesitan justificar la elección de un proveedor (como OpenAI, Anthropic, Google o Meta) basándose en datos de rendimiento real y eficiencia de costes.

Principal ventaja profesional

Proporciona una comparativa objetiva de "Calidad vs. Precio vs. Rendimiento" en tiempo real, eliminando la dependencia de las promesas de marketing de los fabricantes y permitiendo optimizar el ROI de las implementaciones de IA.

Para quién no es

No es una herramienta para usuarios finales que buscan usar un chat de IA para tareas cotidianas. Profesionales de marketing o perfiles no técnicos que no gestionen presupuestos de API o arquitectura de sistemas encontrarán la información demasiado densa o irrelevante para su flujo de trabajo.

Funcionalidades clave

- Intelligence Index: Un índice compuesto que agrega múltiples evaluaciones (razonamiento, programación, matemáticas) para medir la capacidad real de un modelo.

- Comparativa de Proveedores: Análisis de rendimiento de un mismo modelo (ej. Llama 3) a través de diferentes proveedores de infraestructura (AWS, Azure, Groq, Together.ai).

- Métricas de Rendimiento: Datos sobre tokens por segundo, tiempo hasta el primer token (TTFT) y varianza de la velocidad.

- Calculadora de Costes: Comparativas de precios por cada millón de tokens (input/output) y análisis de costes mezclados (ratio 3:1).

- Arena de Medios: Sistemas de votación ciega (ELO) para clasificar modelos de generación de imagen, vídeo y texto-a-voz.

Precios

- Versión gratuita: Acceso a las tablas comparativas web, índices de inteligencia y una API limitada.

- Rango de precios: Gratuito / Bajo presupuesto bajo demanda para datos avanzados.

- Acceso API Gratuita: Limitado a 1.000 solicitudes diarias para métricas primarias de modelos.

- API Comercial: Acceso a datos más granulares y conjuntos de datos completos bajo acuerdos de 'partnership'.

Perfil del usuario

- Empresas de software (SaaS): Que integran LLMs en su producto y necesitan optimizar márgenes.

- Departamentos de IT y Arquitectura: Para validar proveedores de servicios en la nube.

- Equipos de Data Science: Para seleccionar el modelo base más adecuado según el caso de uso (agentes, RAG, codificación).

Nivel técnico requerido

- Para uso web: Nivel medio; conocimiento de conceptos como "tokens", "latencia" y "context window".

- Para integración API: Nivel técnico alto (desarrollo de software).

- Conocimientos necesarios: Comprensión de la arquitectura de LLMs e infraestructuras de inferencia.

Ejemplos de uso profesional

- Selección de Proveedor: Decidir si alojar Llama 3 en Groq (por velocidad) o en AWS Bedrock (por cumplimiento/seguridad) basándose en datos técnicos de latencia.

- Optimización de Costes: Identificar modelos más económicos con capacidades de razonamiento similares para tareas de procesamiento masivo de documentos.

- Evaluación de Alucinaciones: Usar el "AA-Omniscience Index" para seleccionar modelos con menores tasas de error en aplicaciones de consulta de bases de conocimiento.

Uso y distribución

- Versión web: Plataforma principal de consulta a través del navegador.

- API: Para automatizar la ingesta de datos de rendimiento en tableros de control internos.

Integraciones

- API propia: Dispone de una API REST v2 (gratuita con registro) para acceder a métricas de LLM, texto-a-imagen y otros medios.

- Facilidad de integración: Full code. Requiere el uso de claves API y solicitudes HTTP.

- Ejemplos: Conexión con sistemas de monitorización de costes internos para alertar sobre cambios de precios en proveedores.

Notas finales

Información legal, licencias, contratos

- El uso de la API gratuita requiere atribución explícita mediante enlace a la web oficial.

- Prohíbe el uso de los datos para reventa sin consentimiento o para fines competitivos directos.

- La información se proporciona "tal cual", basada en pruebas independientes realizadas por el equipo de Artificial Analysis.

Para más información:

- Sitio web oficial: https://artificialanalysis.ai

- Documentación API: https://artificialanalysis.ai/documentation

- Metodología: https://artificialanalysis.ai/methodology

- Discord: https://discord.gg/artificialanalysis (Suele centralizar su comunidad técnica)

Aplicación profesional

- Empresas tipo SaaS que integran IA en producción, consultoras tecnológicas y departamentos de arquitectura de sistemas.

- Presupuesto: Acceso gratuito para consultas web; costes variables o bajo demanda para integraciones profundas vía API comercial.

- Puntos clave: Optimización de márgenes operativos mediante la selección del proveedor de inferencia más económico y rápido (TPS vs Latencia), auditoría objetiva de proveedores cloud (Azure vs AWS vs Groq) y mitigación de riesgos técnicos al escalar aplicaciones de IA.

Madurez digital requerida

- Usuarios: Desarrolladores de IA, ingenieros de prompts y arquitectos de soluciones con capacidad técnica para interpretar métricas de latencia y estructuras de costes de APIs.

- Empresa: Organizaciones con una infraestructura mínima de despliegue de modelos o que ya gestionan contratos de consumo con proveedores de LLMs.

Plan orientativo de implantación

Pasos necesarios y estimaciones

- Evaluación inicial (1 semana): Auditoría de los modelos actuales en uso y mapeado de casos de uso críticos (ej. RAG, agentes, procesamiento por lotes).

- Prueba de concepto técnico (1-2 semanas): Integración de la API de Artificial Analysis en paneles internos de control para comparar el rendimiento real de los proveedores actuales frente a los líderes del índice.

- Configuración y optimización (2 semanas): Ajuste de los flujos de trabajo basándose en los datos obtenidos (ej. migrar una carga de trabajo de razonamiento complejo a un modelo con mejor ratio latencia/precio según el Intelligence Index).

- Seguimiento y actualización (Continuo): Revisión mensual de los rankings ELO y métricas de velocidad, dado que el mercado de proveedores de inferencia actualiza sus capacidades casi semanalmente.

Necesidades de formación del equipo

- Capacitación en interpretación de métricas de inferencia: Time to First Token (TTFT), varianza de latencia y rendimiento de tokens por segundo.

- Talleres sobre optimización de costes mediante el uso de modelos "small language models" (SLMs) cuando el índice de inteligencia demuestre paridad funcional para tareas específicas.

Perfiles necesarios

- Perfiles técnicos: Ingenieros de Machine Learning (MLE), AI Engineers y especialistas en Cloud/DevOps para la gestión de APIs.

- Personal externo: Consultores independientes en estrategia de IA para la validación inicial del stack tecnológico.

Retorno de la inversión (ROI)

- Tiempos: Los ahorros en costes operativos de API pueden ser inmediatos tras la migración a proveedores más eficientes identificados por la herramienta.

- Cómo medirlo: KPIs basados en la reducción del coste por cada 1.000 solicitudes (cost per request), mejora en los tiempos de respuesta del producto final (latencia extremo a extremo) y reducción de la deuda técnica al elegir modelos con mayor longevidad y soporte.

Otros

- La plataforma es especialmente crítica para aplicaciones de "Real-time AI", donde la métrica de tokens por segundo es el factor limitante del producto.

- El uso del AA-Omniscience Index permite a los responsables de cumplimiento evaluar modelos por su precisión y tasa de error (alucinaciones), un factor determinante para aplicaciones en sectores regulados como el legal o financiero.

Principales recomendaciones

- Uso de Benchmarks como referencia, no como verdad absoluta: Los datos de rendimiento (latencia, tokens/segundo) son capturados en momentos específicos. Un entorno profesional debe validar estos datos en sus propias regiones de despliegue (ej. AWS Europa vs. US).

- Verificación de licencias de modelos externos: Al elegir un modelo basándose en esta plataforma, la empresa debe revisar la licencia específica del modelo (ej. Llama 3 Community License o términos de OpenAI), ya que Artificial Analysis es solo un observador de métricas.

- Atribución obligatoria: Si se utilizan los datos de la API gratuita o capturas de la web para informes internos o productos, es obligatorio incluir un enlace visible a la web oficial para cumplir con sus términos de uso.

- Limitación de responsabilidad en la toma de decisiones: No se deben automatizar cambios de infraestructura críticos basados únicamente en la API de esta herramienta sin supervisión humana, ya que los datos se proporcionan "as-is" (tal cual) y sin garantías de exactitud inmediata.

Privacidad y protección de datos

- Responsabilidades: La plataforma actúa como Responsable del Tratamiento para los datos de registro (email, nombre de usuario). No procesa datos personales de los clientes finales de la empresa usuaria, salvo que se utilicen herramientas específicas como "Image Lab".

- Identificación de usuarios: Se recopilan datos de navegación y uso mediante cookies persistentes para mejorar el servicio y autenticar al profesional.

- Derechos ARCO: Los usuarios pueden ejercer sus derechos de acceso, rectificación, supresión y oposición contactando a hello@artificialanalysis.ai.

- Ubicación de los datos: Artificial Analysis, Inc. es una empresa de Estados Unidos. El uso de su plataforma implica una transferencia internacional de datos (principalmente el email de registro y metadatos de uso).

Propiedad intelectual

- Propiedad de los datos: Artificial Analysis reclama la propiedad intelectual sobre los índices propios (como el "Intelligence Index") y los conjuntos de datos agregados de benchmarking.

- Propiedad del resultado: El usuario mantiene la propiedad de los inputs (prompts) y outputs en herramientas como Image Lab, pero otorga a la plataforma una licencia mundial y perpetua para usar esos datos de forma anonimizada para generar nuevos benchmarks y estudios de mercado.

- Restricciones de copia: Está expresamente prohibido el uso de técnicas de scraping o agentes automatizados para extraer masivamente los datos de la web con el fin de crear un producto competidor.

Usos y prohibiciones

- Usos admitidos: Comparativa técnica de modelos, optimización de costes de API, informes de rendimiento para arquitectura de sistemas y decisiones de compra de infraestructura IA.

- Usos prohibidos: Reventa de los datos obtenidos sin acuerdo comercial, uso de la información para fines competitivos directos contra la plataforma, y proporcionar información de registro falsa.

Otros

- Cláusula de Arbitraje: Los términos de servicio incluyen una cláusula de arbitraje vinculante bajo legislación de EE.UU., lo cual limita la capacidad de una empresa española de litigar en tribunales de la UE en caso de disputas comerciales directas con el proveedor.

- Actualización de términos: La plataforma se reserva el derecho de modificar métricas y accesos a la API sin previo aviso, lo que requiere una monitorización periódica si se integra en cuadros de mando de IT.